ChatGPT-4O et LLMS multimodaux

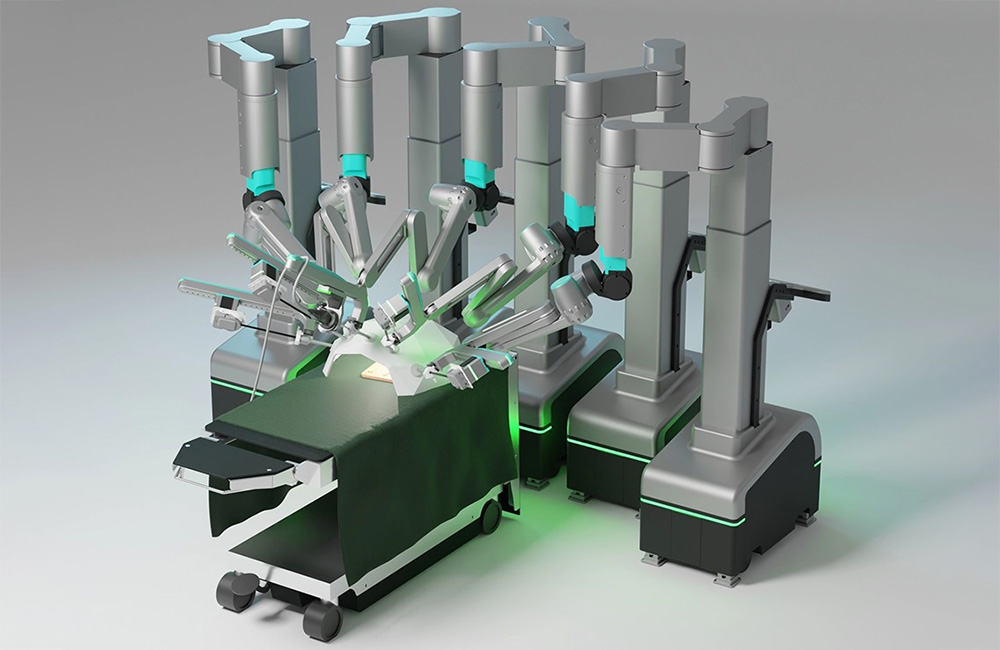

L’avenir de la médecine est sans aucun doute inséparablement associé au développement de l’intelligence artificielle (IA). Bien que cette révolution cuit depuis des années, les derniers mois ont signifié un changement majeur, car les algorithmes ont finalement passé des laboratoires spécialisés et à notre vie quotidienne.

Cette révolution s’est accélérée lorsque les principales sociétés technologiques ont commencé à introduire leurs modèles multimodaux de grandes langues, qui promet d’être bientôt à la disposition du grand public. Le dernier par rapport à l’annonce a peut-être été la plus importante de l’annonce du ChatGPT-4O d’Openai. Le modèle 4O est décrit comme “multimodal natif”, qui est également une fonction pour Google Gemini au début. Bien que les abonnés les profanes manquent encore un accès aux fonctions Gemini multimodales, la multimodalité partielle 4O -S est disponible par utilisation limitée-pour comptes gratuits.

Comment sommes-nous arrivés ici et pourquoi est-ce important? Jetons un coup d’œil au voyage que nous avons voyagé au cours des 18 derniers mois et examinons l’avenir afin que nous puissions comprendre le sens!

Les débuts publics des modèles de grande langue (LLMS), ainsi que Chatgpt, qui sont devenus l’application de consommation à la croissance la plus rapide de tous les temps, a été un succès rugissant. LLM sont des modèles d’apprentissage automatique formés sur un grand nombre de données de texte qui leur permettent de comprendre et de générer du texte humain en fonction des modèles et des structures qu’ils ont appris. Ils diffèrent considérablement des méthodes précédentes d’apprentissage en profondeur, des capacités et de l’impact potentiel.

Les modèles de grandes langues trouveront bientôt un moyen vers l’environnement clinique quotidien, simplement parce que le manque mondial de personnel médical devient désespéré et que l’IA prête des tâches qui ne nécessitent pas de travailleurs de santé qualifiés. Mais avant que cela ne puisse se produire avant d’avoir un cadre de contrôle suffisamment robuste, nous pouvons voir comment cette nouvelle technologie est utilisée dans la vie quotidienne.

Pour mieux comprendre ce qui nous attend, explorons un autre concept clé qui jouera un rôle important dans la transformation de la médecine: multimodacie.

Les médecins et les infirmières sont des supercalculateurs, l’IA médicale est une calculatrice

Le système multimodal peut traiter et interpréter plusieurs types de données d’entrée tels que le texte, les images, le son et la vidéo en même temps. L’AID médical actuel ne traite qu’un seul type de données, telles que des images de texte ou de rayons x.

La médecine, cependant, est par nature aussi multimodale que les humains. Pour le diagnostic et le traitement du patient, le professionnel de la santé écoute le patient, lit ses ensembles de santé, examine les images médicales et interprète les résultats du laboratoire. C’est loin de ce dont toute IA est capable aujourd’hui.

La différence entre les deux peut être comparée à la différence entre le coureur et le pentathlète. Le coureur excelle dans une discipline, tandis que le pentathlet doit exceller dans plusieurs domaines pour réussir.

La plupart des modèles actuels des grandes langues (LLM) sont des coureurs, sont unimodaux. Les gens en médecine sont des champions de l’équipe du pentathlon.

Actuellement, la plupart des modèles de langue (LLM) sont unimodaux, ce qui signifie qu’ils ne peuvent analyser que des textes. Le GPT-4 peut analyser les images et comprendre les commandes vocales dans l’application téléphonique ainsi que le chatpt-4o. Ces modèles peuvent également générer des images. Les autres capacités multimodales ne sont pas encore disponibles pour les abonnés de tous les jours. D’autres LLM largement utilisés, tels que Google Gemini ou Claude AI, peuvent interpréter les défis de l’image (par exemple, un graphique), mais ils ne peuvent pas encore générer des réponses d’image. Pendant ce temps, Google travaillerait sur une arène pionnière d’un langage médical avec un certain nombre de modèles, dont le dernier: Med-Gemini.

Dans l’ensemble, du point de vue d’un futuriste médical, il est clair que le LLM multimodal (M-LLM) avec une fonctionnalité complète arrivera tôt, sinon l’IA ne contribuera pas de manière significative à la nature multimodale de la médecine et des soins. Ces systèmes réduiront considérablement la charge de travail, mais non remplacée par des travailleurs de la santé humaine.

L’avenir est M-llms

Le développement M-LLM aura au moins trois conséquences importantes:

1 .. AI traitera plusieurs types de contenu, des images à son

M-llm sera en mesure de traiter et d’interpréter différents types de contenu, ce qui est essentiel pour une analyse complète en médecine. Nous pourrions donner des centaines d’exemples concernant les avantages d’un tel système, mais dans les cinq prochaines catégories, nous n’en mentionnerons que quelques-uns:

- Analyse de texte: M-LLMS sera en mesure de gérer un grand nombre de tâches administratives, cliniques, éducatives et marketing, car les dossiers médicaux électroniques pour résoudre les études de cas

- Analyse des images: Une autre grande zone en termes de cas d’utilisation potentiel qui comprend des notes écrites manuellement sur l’analyse en radiologie (ophtalmologie, neurologie, pathologie, etc.)

- Analyse solide: M-LLMS devient finalement compétent pour regarder des maladies telles que le contrôle des sons cardiaques et pulmonaires pour des anomalies afin d’assurer une détection précoce, mais les sons peuvent également fournir des informations précieuses sur la santé mentale et la réadaptation

- Analyse vidéo: L’algorithme avancé sera en mesure de diriger un étudiant en médecine en chirurgie de la réalité virtuelle sur la façon de se concentrer, de bouger, de continuer, mais les vidéos pourraient également être utilisées pour détecter les conditions neurologiques ou pour soutenir les patients atteints de langage des signes.

- Une analyse de document compliquée: Cela comprendra une assistance dans un aperçu de la littérature et de la recherche, l’analyse des instructions médicales pour la décision clinique et le codage clinique entre de nombreuses autres formes d’utilisation

2. Il brise les barrières linguistiques

Ces M-LLM font facilement une communication entre les prestataires de soins de santé et les patients qui parlent différentes langues et se traduisent entre différentes langues en temps réel. Tout comme nous l’avons vu comment la traduction en direct fonctionne avec Chatgpt-4o. Il est clair quelle est la suppression potentielle des barrières linguistiques aux réunions médicales.

Spécialiste: “Pouvez-vous s’il vous plaît souligner où ça fait mal?”

M-lm (Traduction pour le patient): “Pouvez-vous souligner où ça fait mal?”

Patient indique un abdomen inférieur.

M-lm (Traduction pour un spécialiste): “Le patient pointe vers le bas de l’abdomen.”

Spécialiste: “Sur une échelle de 1 à 10, comment évalueriez-vous votre douleur?”

M-lm (Traduction pour le patient): “Comment qualifieriez-vous votre douleur 1 à 10?”

Patient: “Il est 8.”

M-lm (Traduction pour un spécialiste): «C’est 8.

3 .. Enfin, l’arrivée de l’interopérabilité peut combiner et harmoniser divers systèmes hospitaliers

M-llm pourrait servir de centre central qui facilite l’accès à diverses IA unimodales utilisées à l’hôpital, telles que les logiciels radiologiques, les logiciels de traitement des assurances, les dossiers médicaux électroniques (DME), etc. est aujourd’hui la situation comme suit:

Une entreprise produit un logiciel pour le département de radiologie qui utilise un certain format d’IA dans son travail quotidien. Un algorithme d’une autre entreprise travaille avec les dossiers médicaux électroniques de l’hôpital et d’autres troisième paramètres suel crée une IA pour construire des rapports d’assurance. Cependant, les médecins ont généralement accès à un système strictement lié à leurs domaines, par exemple, un radiologue a accès à une IA radiologique, mais pas un cardiologue. Et bien sûr, ces algorithmes communiquent entre eux. Si le département de cardiologie a utilisé un algorithme qui analysait les signes de cœur et de poumons, les gastro-entérologues ou les psychiatres n’auraient probablement pas accès – bien que sa constatation puisse être utile pour leur diagnostic.

Une étape importante sera lorsque M-LM-Nakonec sera capable de comprendre la langue et le format de toutes ces applications logicielles et d’aider les gens à communiquer avec eux. Le médecin moyen pourra alors travailler facilement avec les logiciels radiologiques d’IA, les logiciels AI gérant le DME et les quatrième et huitième (etc.) et utilisés à l’hôpital.

Ce potentiel est très important car une telle percée ne se produira pas d’une autre manière. Aucune entreprise avec un tel logiciel ne viendra car elles n’ont pas accès aux données d’IA développées par des entreprises individuelles. Cependant, M-LLM sera en mesure de communiquer avec ces systèmes individuellement et fournira aux médecins en tant que centre central un outil d’une immense importance.

La transition de l’IA unimodale à l’IA multimodale est une étape essentielle vers une utilisation complète du potentiel de l’IA en médecine. En développant M-LLM, qui peut traiter plusieurs types de contenu, interrompre les barrières linguistiques et faciliter l’accès à d’autres applications d’IA, nous pouvons amener la révolution à pratiquer la médecine. La façon de faire la calculatrice après accord avec les superordinateurs que nous appelons les médecins est exigeant, mais devant nos yeux, la révolution se produit.

Le poste de Vision Health Chatgpt-4O et Multimodal LLM est apparu pour la première fois sur un futuriste médical.